EE AI Act: Πρώτος Kανονισμός για την Τεχνητή Νοημοσύνη

Η χρήση της Ai στην ΕΕ θα ρυθμίζεται από τον νόμο για την ΑΙ, τον πρώτο ολοκληρωμένο νόμο για την τεχνητή νοημοσύνη στον κόσμο. Μάθετε πώς θα σας προστατεύσει.

Οι χώρες της Ευρωπαϊκής Ένωσης ετοιμάζονται να υιοθετήσουν το πρώτο στον κόσμο ολοκληρωμένο σύνολο νόμων για τη ρύθμιση της Τεχνητής Νοημοσύνης (AI). Ο κανονισμός AI της ΕΕ επιβάλλει τους πιο αυστηρούς κανόνες στα πιο επικίνδυνα μοντέλα Ai και έχει σχεδιαστεί για να διασφαλίζει ότι τα συστήματα είναι ασφαλή και σέβονται τα θεμελιώδη δικαιώματα και τις αξίες της ΕΕ.

"Ο νόμος έχει τεράστιες συνέπειες, καθώς διαμορφώνει τον τρόπο που σκεφτόμαστε τη ρύθμιση της ΤΝ και θέτει ένα σημαντικό προηγούμενο", λέει ο Rishi Bommasani, ο οποίος ερευνά τις κοινωνικές επιπτώσεις της Ai στο Πανεπιστήμιο Stanford της Καλιφόρνια.

Οι κυβερνήσεις των κρατών της ΕΕ ενέκριναν τη νομοθεσία στις 2 Φεβρουαρίου και τώρα ο νόμος χρειάζεται την τελική έγκριση του Ευρωπαϊκού Κοινοβουλίου, ενός από τους τρεις νομοθετικούς κλάδους της ΕΕ.

Αυτό αναμένεται να συμβεί τον Απρίλιο. Εάν το κείμενο παραμείνει αμετάβλητο, όπως αναμένουν οι παρατηρητές της πολιτικής, ο νόμος θα τεθεί σε ισχύ το 2026.

Ποια είναι η στρατηγική της ΕΕ?

Οι νέοι κανόνες για την Ai θέλουν να βοηθήσουν τους δημιουργούς, τους χρήστες και όσους χρησιμοποιούν την Ai γενικά να καταλάβουν τι επιτρέπεται και τι όχι. Παράλληλα, κάνουν τη ζωή πιο εύκολη για τις επιχειρήσεις, ειδικά τις μικρές, μειώνοντας τα χαρτιά και τα έξοδα.

Αυτοί οι κανόνες είναι μέρος ενός μεγαλύτερου σχεδίου, που λέει πώς πρέπει να χρησιμοποιείται η Ai ώστε να μην κινδυνεύει κανείς και να σέβονται τα δικαιώματά μας. Επίσης, στόχος είναι να ενθαρρυνθούν οι επιχειρήσεις και η καινοτομία στην Ai σε όλη την Ευρώπη.

Ο προτεινόμενος κανονισμός για την τεχνητή νοημοσύνη διασφαλίζει ότι οι Ευρωπαίοι μπορούν να εμπιστεύονται αυτό που έχει να προσφέρει. Ενώ τα περισσότερα συστήματα τεχνητής νοημοσύνης ενέχουν περιορισμένο κίνδυνο και μπορούν να συμβάλουν στην επίλυση πολλών κοινωνικών προκλήσεων, ορισμένα συστήματα τεχνητής νοημοσύνης δημιουργούν κινδύνους που πρέπει να αντιμετωπίσουμε για να αποφύγουμε ανεπιθύμητα αποτελέσματα.

Οι προτεινόμενοι κανόνες θα:

Αντιμετωπίζουν ειδικά κινδύνους που δημιουργούνται από εφαρμογές τεχνητής νοημοσύνης.

Προτείνουν μια λίστα υψηλού κινδύνου εφαρμογών.

Θέτουν σαφείς απαιτήσεις για συστήματα τεχνητής νοημοσύνης που αφορούν υψηλού κινδύνου εφαρμογές.

Καθορίζουν συγκεκριμένες υποχρεώσεις για χρήστες και παρόχους υψηλού κινδύνου εφαρμογών τεχνητής νοημοσύνης.

Προτείνουν μια αξιολόγηση συμμόρφωσης πριν το σύστημα τεχνητής νοημοσύνης τεθεί σε λειτουργία ή βγει στην αγορά.

Προτείνουν επιβολή μετά τη θέση στην αγορά ενός τέτοιου συστήματος τεχνητής νοημοσύνης.

Προτείνουν μια δομή διακυβέρνησης σε ευρωπαϊκό και εθνικό επίπεδο.

AI Act Νομοθετικό Πλαίσιο

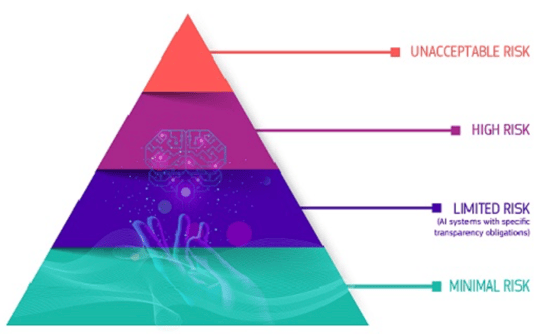

Το κανονιστικό πλαίσιο ορίζει 4 επίπεδα κινδύνου στην Ai:

Όλα τα συστήματα τεχνητής νοημοσύνης που θεωρούνται σαφής απειλή για την ασφάλεια, τα μέσα διαβίωσης και τα δικαιώματα των ανθρώπων θα απαγορευτούν, από την κοινωνική βαθμολόγηση από τις κυβερνήσεις.

Υψηλού Kινδύνου

Τα συστήματα Ai που εντοπίζονται ως υψηλού κινδύνου περιλαμβάνουν την τεχνολογία τεχνητής νοημοσύνης που χρησιμοποιείται:

Σε κρίσιμες υποδομές (π.χ. μεταφορές), που θα μπορούσαν να θέσουν σε κίνδυνο τη ζωή και την υγεία των πολιτών.

Στην εκπαίδευση ή την επαγγελματική κατάρτιση, που μπορεί να καθορίσει την πρόσβαση σε εκπαίδευση και την επαγγελματική πορεία κάποιου.

Στη διοίκηση της δικαιοσύνης και των δημοκρατικών διαδικασιών.

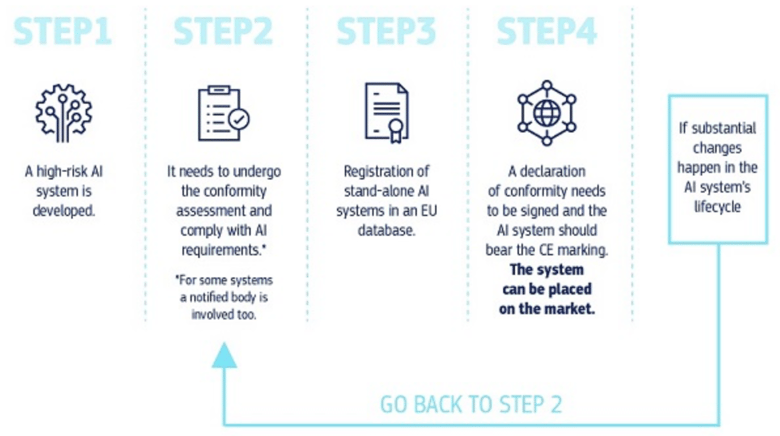

Τα συστήματα Ai υψηλού κινδύνου θα υπόκεινται σε αυστηρές υποχρεώσεις πριν μπορέσουν να τεθούν στην αγορά:

Υψηλή ποιότητα των συνόλων δεδομένων που τροφοδοτούν το σύστημα για την ελαχιστοποίηση των κινδύνων και διακριτικών αποτελεσμάτων.

Λεπτομερής τεκμηρίωση που παρέχει όλες τις απαραίτητες πληροφορίες σχετικά με το σύστημα και τον σκοπό του, προκειμένου οι αρχές να αξιολογήσουν τη συμμόρφωσή του.

Κατάλληλα μέτρα ανθρώπινης επιβολής για την ελαχιστοποίηση του κινδύνου.

Περιορισμένοι Kίνδυνοι

Ο περιορισμένος κίνδυνος αναφέρεται σε συστήματα τεχνητής νοημοσύνης με συγκεκριμένες υποχρεώσεις διαφάνειας. Όταν χρησιμοποιούνται συστήματα τεχνητής νοημοσύνης, όπως τα chatbots, οι χρήστες πρέπει να γνωρίζουν ότι αλληλεπιδρούν με ένα μηχάνημα, ώστε να λάβουν ενημερωμένη απόφαση για να συνεχίσουν ή να αποσυρθούν.

Ελάχιστος ή Χωρίς Κίνδυνο

Η προτεινόμενη πρόταση επιτρέπει την ελεύθερη χρήση της ΤΝ ελάχιστου κινδύνου. Αυτό περιλαμβάνει εφαρμογές όπως βιντεοπαιχνίδια με τεχνητή νοημοσύνη ή φίλτρα ανεπιθύμητης βοήθειας. Η μεγάλη πλειονότητα των συστημάτων ΤΝ που χρησιμοποιούνται σήμερα στην ΕΕ ανήκουν σε αυτή την κατηγορία.

Απαράδεκτος Kίνδυνος

Τα συστήματα τεχνητής νοημοσύνης που θεωρούνται απαράδεκτος κίνδυνος θα απαγορεύονται, καθώς αποτελούν απειλή για τους ανθρώπους. Αυτά περιλαμβάνουν:

Γνωστική συμπεριφορική ψευδαίσθηση ανθρώπων ή συγκεκριμένων ευάλωτων ομάδων: για παράδειγμα, παιχνίδια με τεχνητή νοημοσύνη που ενθαρρύνουν επικίνδυνη συμπεριφορά σε παιδιά.

Κοινωνική αξιολόγηση: ταξινομώντας τους ανθρώπους βάσει συμπεριφοράς, κοινωνικοοικονομικής θέσης ή προσωπικών χαρακτηριστικών.

Βιομετρική αναγνώριση και κατηγοριοποίηση ανθρώπων.

Συστήματα βιομετρικής αναγνώρισης πραγματικού χρόνου και απομακρυσμένης βιομετρικής αναγνώρισης, όπως η αναγνώριση προσώπου.

Πώς Λειτουργεί στην Πράξη

Μόλις ένα σύστημα Ai κυκλοφορήσει στην αγορά, οι αρχές είναι υπεύθυνες για την παρακολούθηση της αγοράς, οι χρήστες διασφαλίζουν την ανθρώπινη εποπτεία και παρακολούθηση και οι πάροχοι διαθέτουν ένα σύστημα παρακολούθησης μετά την κυκλοφορία. Οι πάροχοι και οι χρήστες θα αναφέρουν επίσης σοβαρά περιστατικά και δυσλειτουργίες.

AI Act: Νομοθεσία για το Mέλλον

Καθώς η Ai είναι μια τεχνολογία που εξελίσσεται με ταχείς ρυθμούς, η πρόταση έχει μια προσέγγιση που είναι ανθεκτική στο μέλλον, επιτρέποντας στους κανόνες να προσαρμόζονται στις τεχνολογικές αλλαγές. Οι εφαρμογές AI θα πρέπει να παραμένουν αξιόπιστες ακόμη και μετά τη διάθεσή τους στην αγορά. Αυτό απαιτεί συνεχή διαχείριση της ποιότητας και των κινδύνων από τους παρόχους.

Επόμενα βήματα

Μετά την πρόταση της Επιτροπής τον Απρίλιο του 2021, ο κανονισμός θα μπορούσε να τεθεί σε ισχύ στα τέλη του 2022 / αρχές του 2023 κατά τη διάρκεια μιας μεταβατικής περιόδου.

Κατά τη διάρκεια αυτής της περιόδου, θα επιβάλλονται και θα αναπτύσσονται πρότυπα, και οι θεσμικές δομές που θα δημιουργηθούν θα είναι λειτουργικές.

Το δεύτερο εξάμηνο του 2024 είναι ο πιο νωρίς χρόνος που ο κανονισμός θα μπορούσε να τεθεί σε ισχύ για τους φορείς με τα πρότυπα έτοιμα και τις πρώτες αξιολογήσεις συμμόρφωσης πραγματοποιημένες.

Πηγές:

European Commission. (n.d.). Shaping the digital future: Regulatory framework for Artificial Intelligence. Retrieved from https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai

European Parliament. (2023, June 1). EU AI Act - First regulation on artificial intelligence. Retrieved from https://www.europarl.europa.eu/topics/en/article/20230601STO93804/eu-ai-act-first-regulation-on-artificial-intelligence